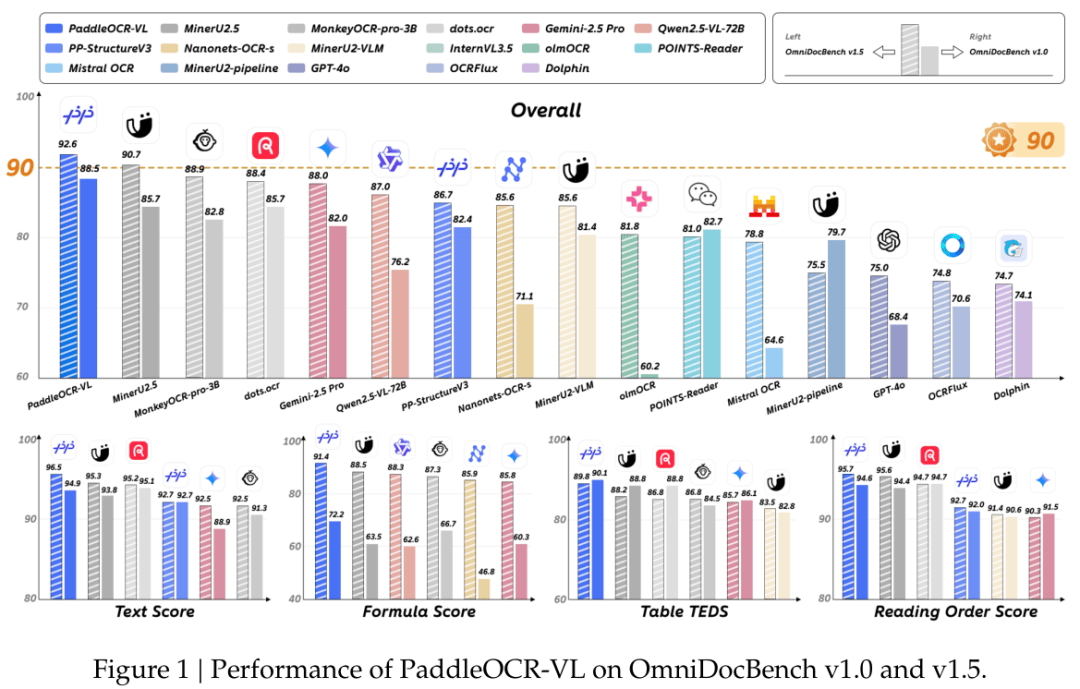

百度用一个仅0.9B参数的模型,在权威的文档解析评测榜单OmniDocBench V1.5上,拿下了92.6分的综合成绩,位列全球第一。

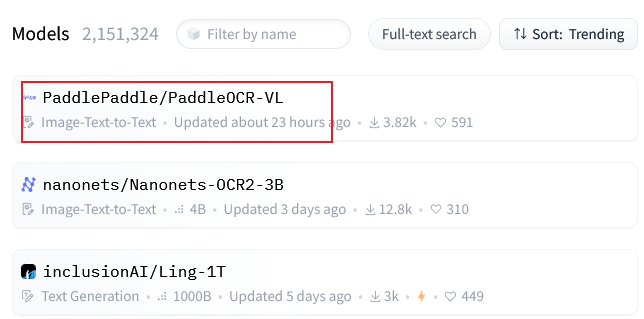

这个叫作PaddleOCR-VL的模型,发布不到一天,就在技术圈的开源社区Hugging Face上冲到了全球热度榜首。现在仍然霸榜。

它不只是总分高,在文本识别,公式识别,表格理解和阅读顺序这四个文档解析最核心的能力维度上,全都做到了业界最佳水平,是目前唯一一个在这四项上全部登顶的模型。

它还能处理109种语言,从常见的中文,英文,日文,韩文,到结构复杂的俄语(西里尔字母),阿拉伯语,印地语(天城文)和泰语,基本覆盖了全球主要语言体系。

这个事儿有意思的地方在于,当下大家普遍的认知是模型参数量越大,能力越强。百度这个0.9B参数的模型能取得这样的成绩,怎么做到的?

庖丁解牛,先把任务拆开

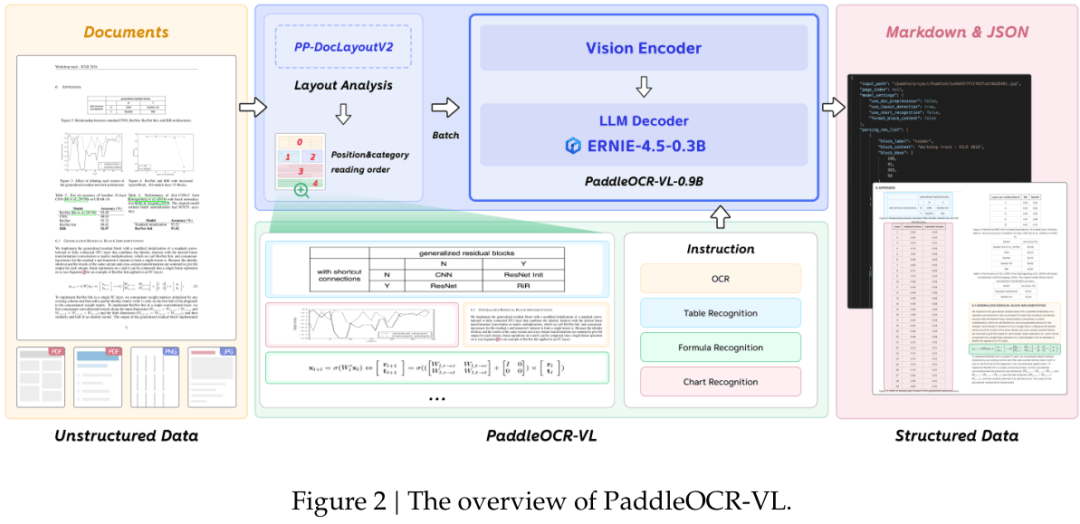

模型能做到又小又强,关键在于它的设计思路。PaddleOCR-VL没有选择做一个大而全的端到端模型,把一张文档图片直接扔进去,让模型自己搞定所有事。

那种方法听起来很酷,但在实际应用中常常会遇到麻烦,比如模型容易产生幻觉,搞错文本的阅读顺序,或者在处理复杂长文档时计算成本高得吓人,难以落地。

PaddleOCR-VL用的是一个两阶段架构。